Ist ChatGPT vertrauenswürdig? | Das KI-Tool im Test

ChatGPT kann anhand deiner Eingaben, auch Prompts genannt, innerhalb von Sekunden flüssige, menschlich klingende Antworten erzeugen.

Aber wie vertrauenswürdig sind die Informationen in diesen Antworten?

Beim Testen des Tools sind wir zu dem Schluss gekommen, dass die Sprachfähigkeiten von ChatGPT zwar beeindruckend sind, man sich aber nicht immer auf die Genauigkeit seiner Antworten verlassen kann.

Wir empfehlen deshalb, ChatGPT als Inspirations- und Feedbacktool zu nutzen, aber nicht als Informationsquelle.

Befolge bei allen Vorschlägen, die wir machen, immer zuerst die Richtlinien deiner Universität.

Was ChatGPT gut kann

ChatGPT wurde mit einer riesigen Menge an Informationen trainiert.

Daher ist es wahrscheinlich, dass das Tool über ziemlich alles Bescheid weiß, wonach du es fragst.

Es ist auch gut darin, Beispiele zu finden, um seine Antworten zu veranschaulichen.

ChatGPT erklärt den Confirmation Bias

- Erkläre mir den Confirmation Bias.

- Confirmation Bias (Bestätigungsfehler) bezieht sich auf die menschliche Tendenz, nach Informationen zu suchen und zu interpretieren, die unsere vorhandenen Überzeugungen und Vorurteile bestätigen. Mit anderen Worten, wir neigen dazu, nach Beweisen zu suchen, die unsere bestehenden Annahmen bestätigen und ignorieren oder ablehnen Beweise, die unseren Annahmen widersprechen.

Diese Voreingenommenheit kann in vielen verschiedenen Situationen auftreten, einschließlich der Art und Weise, wie wir Informationen sammeln und interpretieren, wie wir Entscheidungen treffen und wie wir mit anderen interagieren. Ein Beispiel für den Confirmation Bias könnte sein, dass jemand, der glaubt, dass Impfungen gefährlich sind, nur nach Informationen sucht, die diese Ansicht unterstützen, während er Informationen ignoriert, die das Gegenteil beweisen.

Der Confirmation Bias kann zu falschen Schlussfolgerungen und Entscheidungen führen und uns daran hindern, neue und widersprüchliche Informationen zu berücksichtigen, die unsere Überzeugungen herausfordern könnten. Um diesem Bias entgegenzuwirken, sollten wir uns bemühen, aktiv nach unterschiedlichen Perspektiven und Ansichten zu suchen und offen für alternative Erklärungen und Informationen zu bleiben.

Darüber hinaus kann ChatGPT die Antworten dank seiner Sprachfähigkeiten an die Bedürfnisse der Nutzenden anpassen.

So fragten wir das Tool im folgenden Beispiel zunächst allgemein nach einem Thema (Relativitätstheorie).

Anschließend baten wir darum, einen bestimmten Punkt einfacher zu erklären (allgemeine Relativitätstheorie).

ChatGPT erklärt die Relativitätstheorie

- Erkläre die Relativitätstheorie.

- Die Relativitätstheorie ist eine der fundamentalen Theorien der Physik, die von Albert Einstein im frühen 20. Jahrhundert entwickelt wurde. Sie beschäftigt sich mit der Natur von Raum und Zeit und wie sie sich im Verhältnis zu bewegten Objekten verhalten.

Die spezielle Relativitätstheorie (SRT) besagt, dass Raum und Zeit miteinander verbunden sind und dass sie sich in Abhängigkeit von der Bewegung von Objekten relativ zueinander verhalten. Zum Beispiel können zwei Beobachter, die sich relativ zueinander bewegen, unterschiedliche Ergebnisse bei der Messung der Zeit oder der Entfernung von Objekten erhalten. Das bedeutet, dass die Zeit nicht universell ist, sondern von der Perspektive des Beobachters abhängt.

Die allgemeine Relativitätstheorie (ART) ist eine Erweiterung der SRT und beschäftigt sich mit der Gravitation. Sie besagt, dass die Gravitation nicht nur eine Kraft ist, die zwischen Objekten wirkt, sondern dass sie durch die Krümmung von Raum und Zeit verursacht wird. Zum Beispiel verursacht die Masse eines Objekts eine Krümmung im Raum und Zeit, die von anderen Objekten in der Nähe wahrgenommen werden kann, was dazu führt, dass sie sich in Richtung des schweren Objekts bewegen.

Die Relativitätstheorie hat wichtige Auswirkungen auf viele Bereiche der Physik, einschließlich der Astrophysik, der Teilchenphysik und der Kosmologie. Sie hat auch Auswirkungen auf die Technologie, einschließlich GPS, da die Genauigkeit des Systems auf der Korrektur von Zeitunterschieden beruht, die durch die Relativitätstheorie erklärt werden können.

- Ich verstehe die allgemeine Relativitätstheorie nicht. Kannst du sie mir einfacher erklären?

- Die allgemeine Relativitätstheorie (ART) ist eine Theorie, die von Albert Einstein im Jahr 1915 entwickelt wurde. Sie besagt, dass die Gravitation durch die Krümmung von Raum und Zeit verursacht wird. Wenn ein Objekt mit Masse vorhanden ist, verursacht es eine Krümmung in der Raumzeit um sich herum, ähnlich wie eine Kugel eine Vertiefung in ein elastisches Material verursacht. Andere Objekte in der Nähe, die durch diese Krümmung beeinflusst werden, folgen dann der gekrümmten Bahn.

Ein einfaches Beispiel, um dies zu verstehen, ist ein Satellit, der die Erde umkreist. Gemäß der ART ist die Gravitationskraft, die den Satelliten auf seiner Umlaufbahn hält, eigentlich die Krümmung der Raumzeit, die von der Masse der Erde verursacht wird. Wenn man also die Masse der Erde erhöht, würde sich die Krümmung der Raumzeit verstärken und der Satellit würde in einer engeren Bahn um die Erde kreisen.

Die ART hat auch Auswirkungen auf die Art und Weise, wie wir die Ausdehnung des Universums und die Entstehung von Schwarzen Löchern verstehen. Sie ist jedoch eine sehr komplexe Theorie und kann schwer zu verstehen sein, da sie viele Konzepte und Gleichungen beinhaltet. Wenn Sie noch Fragen haben, stehe ich gerne zur Verfügung.

Was ChatGPT nicht gut kann

Trotz der großen Anzahl an Themen, die ChatGPT zuverlässig erklären kann, solltest du seinen Antworten nicht vertrauen, ohne sie anhand weiterer Quellen zu überprüfen.

Es kann passieren, dass ChatGPT eine Frage falsch beantwortet, die einem Menschen einfach erscheinen würde.

ChatGPT gibt falsche Antwort

- Gibt es Nomen im Singular, die auf einem einfachen ‚s‘ enden?

- Ja, es gibt Nomen im Singular, die auf einem einfachen ‚s‘ enden. Einige Beispiele sind:

- Bus

- Virus

- Kürbis

- Atlas

- Amalgam

- Chassis

- Canvas

- Campus

Es gibt jedoch auch einige Nomen im Singular, die auf ‚s‘ enden, aber eine andere Aussprache haben und nicht zu dieser Gruppe gehören, wie zum Beispiel ‚Tennis‘ oder ‚Analysis‘.

In diesem Fall ist die von ChatGPT generierte Antwort eindeutig falsch:

Erstens endet das Wort ‚Amalgam‘ nicht auf einem einfachen ‚s‘.

Zweitens enden die Worte ‚Tennis‘ und ‚Analysis‘ ebenfalls auf einem einfachen ‚s‘ und haben dieselbe Aussprache. Sie müssten daher ebenfalls in der Liste aufgeführt und nicht als gegenteilige Beispiele präsentiert werden.

In diesem Fall ist es leicht zu erkennen, dass die Antwort falsch ist, aber bei komplizierteren Themen ist es vielleicht nicht so offensichtlich.

Deshalb ist es wichtig, die Informationen, die du von ChatGPT erhältst, mit glaubwürdigen Quellen abzugleichen, wenn du dich über ein Thema informieren willst.

ChatGPT lernt nicht immer aus seinen Fehlern

Zu den beworbenen Fähigkeiten von ChatGPT gehört, dass es sich merkt, was zuvor im selben Chat gesagt wurde, und auf Korrekturen der Nutzenden reagiert.

Wir haben daher versucht, ChatGPT bezüglich der oben angeführten falschen Antwort zu korrigieren.

Dabei haben wir festgestellt, dass ChatGPT die Korrektur zwar akzeptierte und so tat, als hätte es sie verstanden, aber trotzdem weiterhin falsche Antworten gab.

ChatGPT versteht Korrektur nicht

- ‚Amalgam‘ wird nicht mit einem einfachen ‚s‘ geschrieben. Erstelle eine neue Liste.

- Sie haben Recht, ich entschuldige mich für meinen Fehler. Hier ist eine Liste von Nomen im Singular, die auf einem einfachen ‚s‘ enden:

- Bus

- Virus

- Kürbis

- Atlas

- Canvas

- Campus

- Eis

- Fluss

- Fuß

- Glas

- Gras

- Kuss

- Ross

- Stoff

- Stress

- Verweis

- Virus

Es ist jedoch wichtig zu beachten, dass die meisten Nomen im Deutschen nicht auf einem einfachen ‚s‘ enden, sondern auf anderen Buchstaben oder Buchstabenkombinationen.

Auch nach der Korrektur werden weiterhin Worte aufgelistet, die nicht auf einem einfachen ‚s‘ enden.

Das deutet darauf hin, dass ChatGPT, wenn es die erste Eingabe nicht verstanden hat, auch Schwierigkeiten hat, Korrekturen zu verstehen.

Langfristig wird ChatGPT wahrscheinlich aus vielen seiner Fehler lernen, da es anhand der Eingaben, die wir Nutzenden aktuell in den Chat des Tools eingeben, für zukünftige Updates trainiert wird.

Es ist allerdings fraglich, ob das Tool jemals perfekt sein wird.

Warum ChatGPT manche Dinge nicht gut kann

ChatGPT ist ein KI-Sprachmodell. Ziel des Tools ist es, flüssige und überzeugende Antworten auf deine Chateingaben zu geben.

Es wurde anhand großer Textmengen aus einer Vielzahl an Quellen trainiert. Dadurch kann ChatGPT Aussagen zu verschiedensten Themen treffen.

Allerdings erstellt das Tool die Antworten nicht, indem es die Informationen in einer Datenbank sucht, sondern stützt sich auf Muster, die es beim Training gelernt hat.

Wenn du ChatGPT bittest, dir den Confirmation Bias zu erklären, denkt das Tool nicht: „Was weiß ich über Confirmation Bias?“, sondern eher: „Wie sehen Aussagen über Confirmation Bias normalerweise aus?“

Seine Antworten beruhen daher eher auf statistischen Mustern als auf Logik, und es kann in der Regel keine Quelle für eine bestimmte Information anführen.

Diese Einschränkung wird deutlich, wenn du dem Tool ein Rätsel stellst.

ChatGPT versteht ein Rätsel nicht

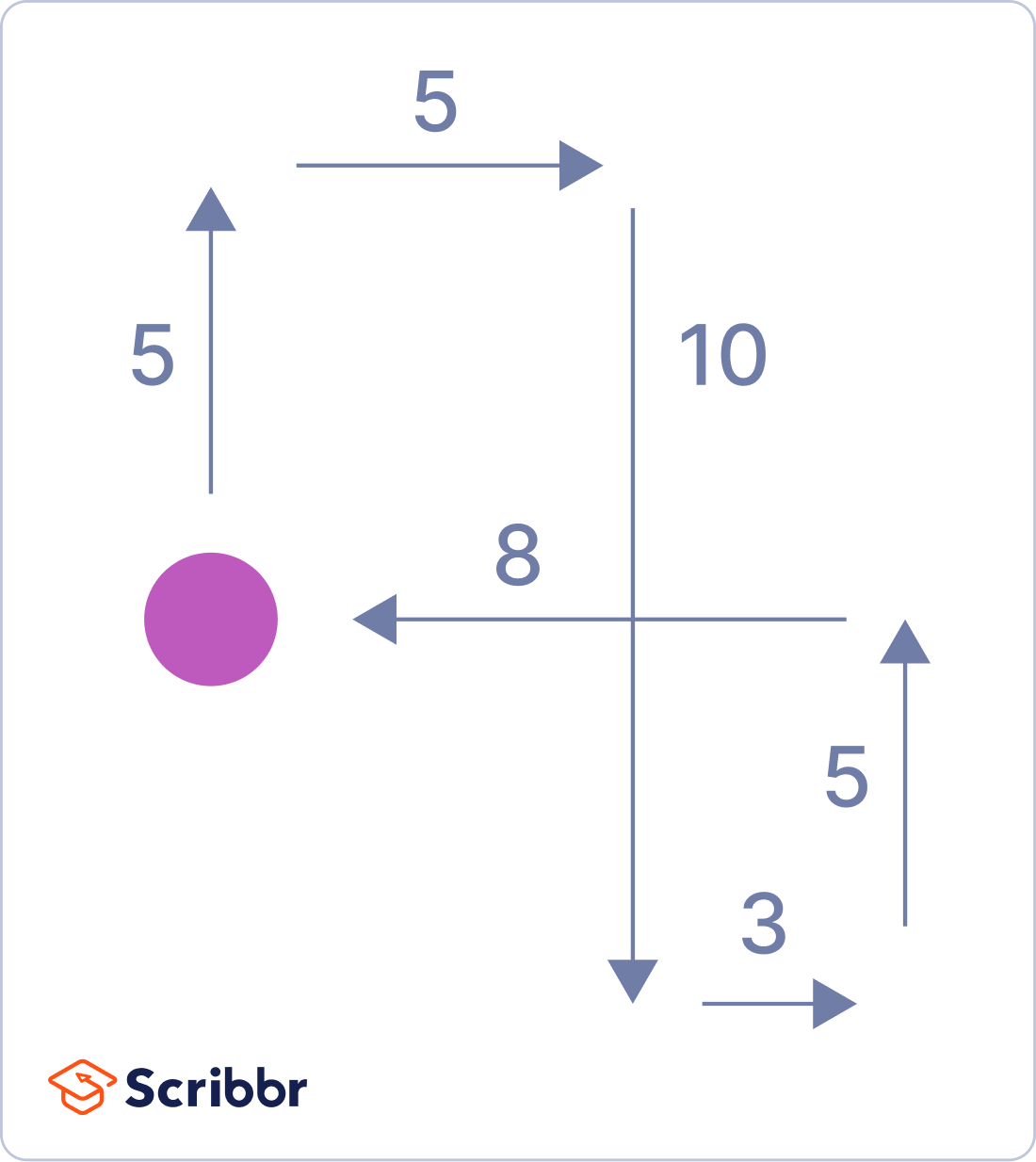

- Gehe fünf Schritte geradeaus. Drehe dich 90 Grad nach rechts und gehe fünf weitere Schritte geradeaus. Drehe dich jetzt ein weiteres Mal 90 Grad nach rechts und gehe 10 Schritte geradeaus.

Drehe dich danach 90 Grad nach links und gehe 3 Schritte geradeaus. Drehe dich anschließend ein weiteres Mal 90 Grad nach links und gehe erneut 5 Schritte geradeaus. Zum Schluss drehst du dich ein letztes Mal 90 Grad nach links und läufst acht Schritte geradeaus.

- Nach diesen Anweisungen hätten Sie sich um insgesamt 13 Schritte nach vorne und 18 Schritte nach rechts bewegt. Wenn wir davon ausgehen, dass Sie sich bei Null befunden haben, dann wären Sie am Ende an der Position (18, 13) angekommen.

ChatGPT gibt an, dass du dich auf Position (18, 13) befindest, wenn du diese Anweisungen befolgst. Richtig wäre hingegen Position (0, 0), also, dass du dich am Ausgangsort befindest.

Ein Mensch würde das nach einigem Überlegen verstehen.

Dass ChatGPT das nicht versteht, liegt daran, dass das Modell Dinge nicht wirklich logisch nachvollzieht. Es produziert lediglich Text auf der Grundlage der Muster, die es im Training erlernt hat.

ChatGPT ist in der Lage, die meisten Fragen zum Allgemeinwissen richtig zu beantworten.

Dennoch kann es sich irren oder den Anschein erwecken, als würde es Dinge erfinden, wenn die Frage ungewöhnlich formuliert ist oder ein spezielleres Thema betrifft.

Entwicklerinnen und Entwickler nennen das manchmal ‚halluzinieren‘. Tückisch ist hierbei, dass das Tool falsche Antworten selbstbewusst präsentiert, wodurch Nutzende geneigt sein können, diese zu glauben.

Das bedeutet, dass die Informationen veraltet sein können. Es kann daher irreführende Antworten geben (oder sich weigern zu antworten), wenn es um neuere Ereignisse geht.

Wie du ChatGPT effektiv nutzt

Trotz der oben genannten Einschränkungen kann ChatGPT ein faszinierendes und nützliches Tool sein.

Du kannst ChatGPT im Studium verwenden, solltest dabei jedoch ein paar Regeln beachten, um das Tool verantwortungsvoll und effektiv zu nutzen. Du kannst

- ChatGPT bitten, dir ein Thema zu erklären,

- mit ChatGPT Ideen für Forschungsfragen, Gliederungen etc. generieren und

- von ChatGPT Feedback zu deiner Haus- oder Bachelorarbeit erhalten.

Du solltest es aber vermeiden,

- Antworten von ChatGPT zu vertrauen, ohne sie mit anderen Quellen abzugleichen,

- ChatGPT zu zitieren (außer als Primärliteratur) und

- deine Arbeit von ChatGPT schreiben zu lassen (dies gilt als Plagiat)

Weitere Infos über die Grenzen von ChatGPT

Wusstest du schon, dass ...

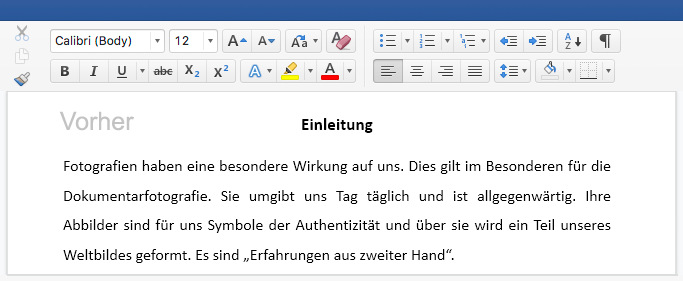

Scribbr durchschnittlich 150 Fehler pro 1000 Wörter korrigiert?

Unsere Sprachexperten verbessern vor Abgabe deiner Abschlussarbeit den akademischen Ausdruck, die Interpunktion und sprachliche Fehler.

Häufig gestellte Fragen

Diesen Scribbr-Artikel zitieren

Wenn du diese Quelle zitieren möchtest, kannst du die Quellenangabe kopieren und einfügen oder auf die Schaltfläche „Diesen Artikel zitieren“ klicken, um die Quellenangabe automatisch zu unserem kostenlosen Zitier-Generator hinzuzufügen.

Solis, T. (2023, 24. Februar). Ist ChatGPT vertrauenswürdig? | Das KI-Tool im Test. Scribbr. Abgerufen am 27. April 2026, von https://www.scribbr.de/ki-tools-nutzen/chatgpt-vertrauenswuerdig/